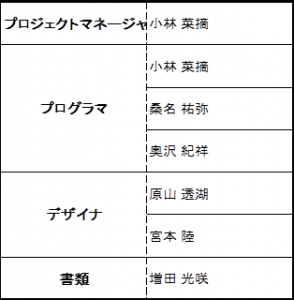

Member

Project Manager: Natsumi Kobayashi

Programmer: Natsumi Kobayashi, Yuya Kuwana, Kisho Okuzawa

Designer: Toko Harayama, Riku Miyamoto

Document: Misaki Masuda

Content & Background

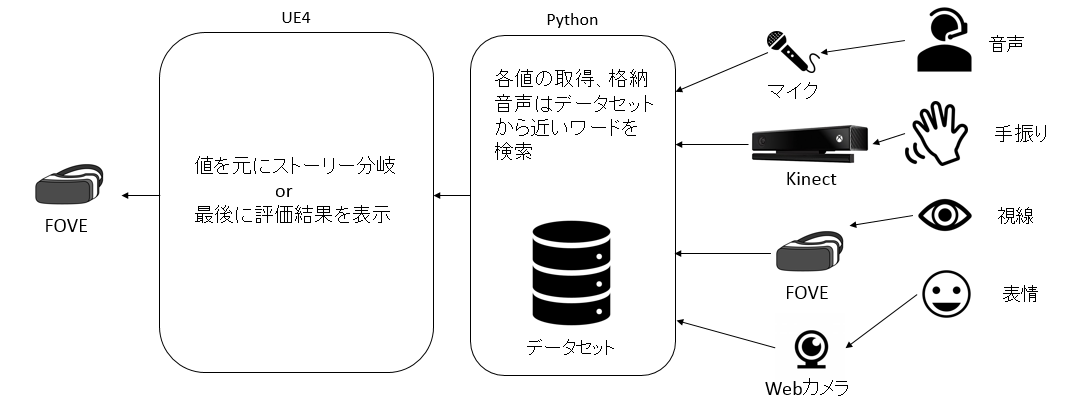

This project makes available “Body Extension” experience by using shadow for everyone who is healthy or disabled for experience.

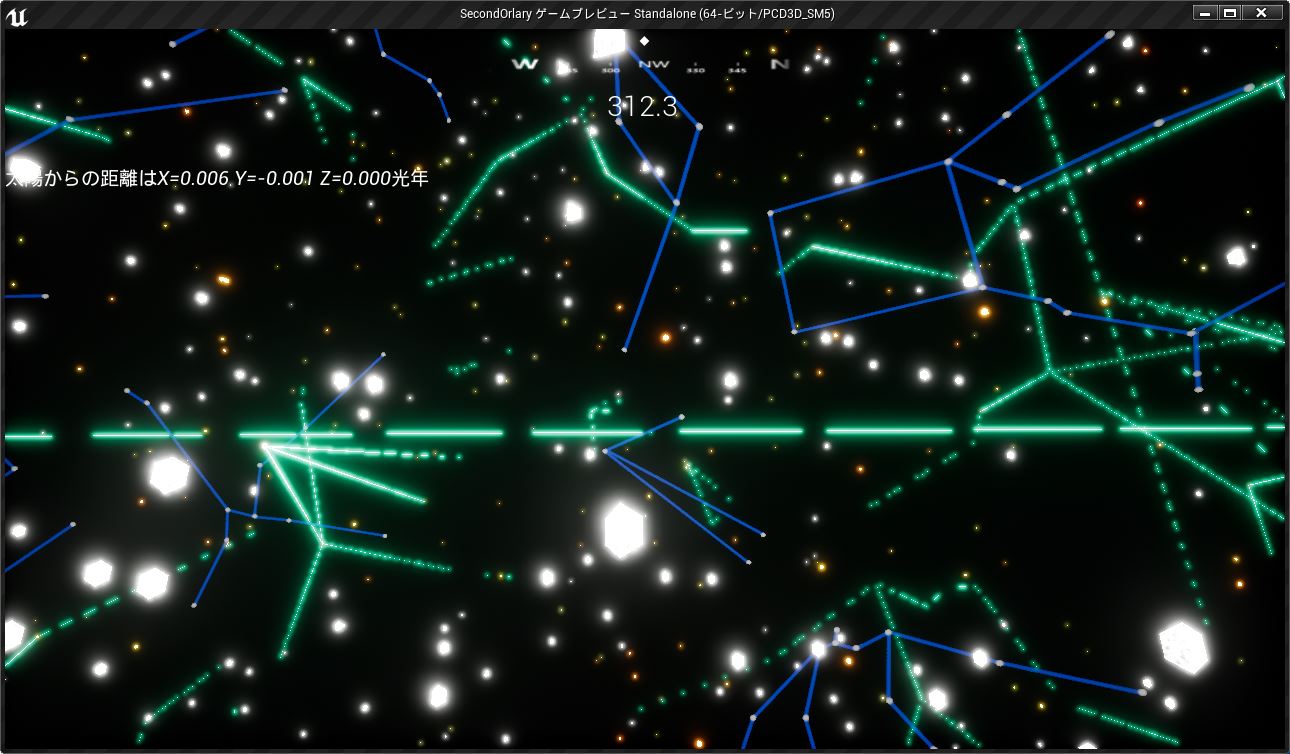

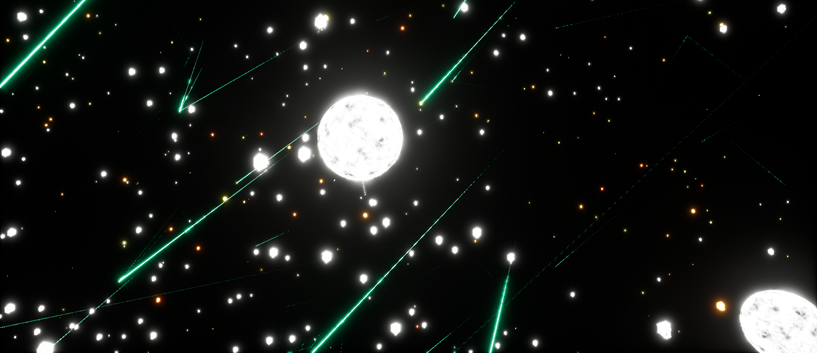

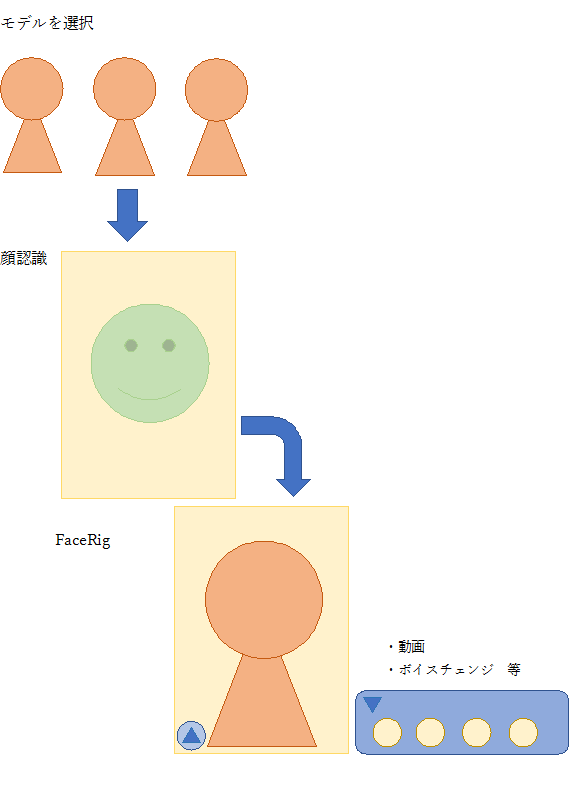

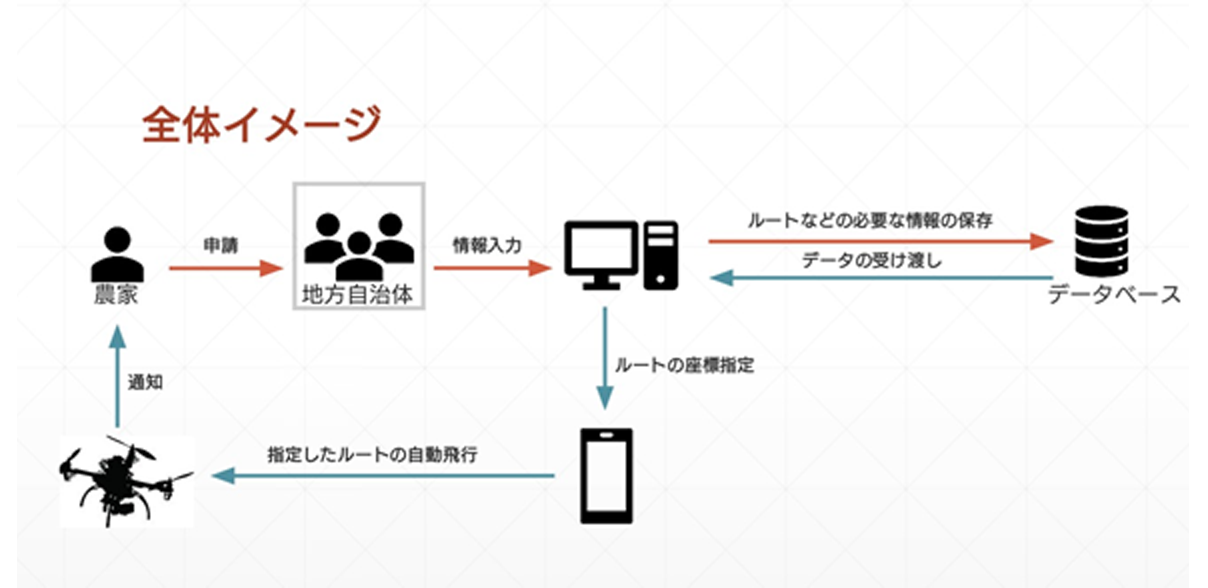

Using Kinect, recognize people and generate shadows ; arduino captures some myoelectric potential and some pulses, to expand the body by Unity. Thereby, people with physical disabilities in the body and healthy people alike can experience “Body Extension” by shadow.

Purpose

Making experience situations available by “Body Extension” by using shadow this is not influenced by individual physique and physical ability.

Goal

◾Making contents which people can enjoy fairness and isn’t influenced by individual physique and physical ability.

◾Have everyone experience “Body Extension” by shadow.

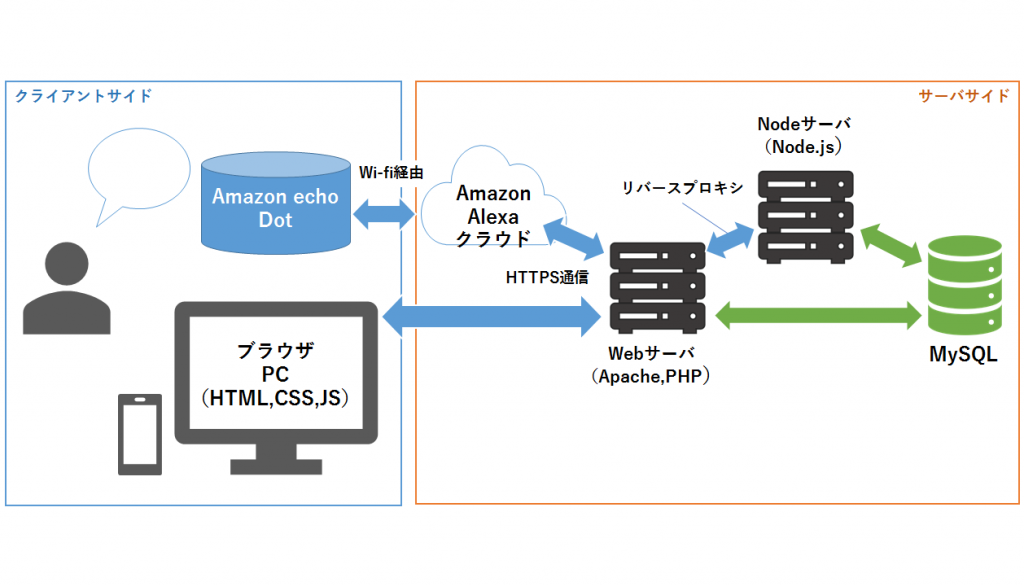

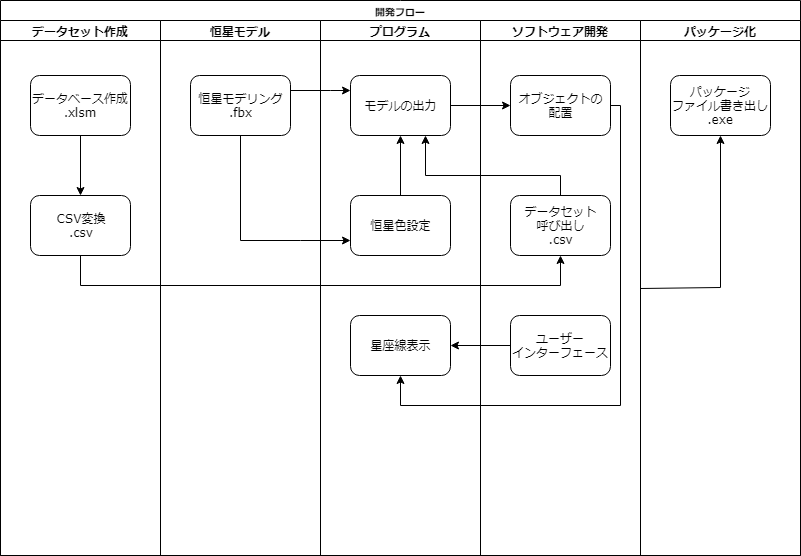

Development Environment

Game Engine: Unity

Language: C#, Ruby

Framework: Ruby on rails

Database: postgreSQL

Server: AWS, heroku

Virtual Environment: docker

Device: kinect,arduino, web camera, googleHome

Tool: github